特斯拉賣不動的自動駕駛,車聯網能救嗎?

2020-01-10 11:36

新年伊始,特斯拉宣布,僅用不到一年時間建成的上海特斯拉工廠生產的的Model 3將大幅降價。Model 3標准續航升級版起售價從35.58萬下調至32.38萬,同時,購車還將獲得高額補貼,最後用戶到手價為29.905萬元。不到30萬,就能買到的特斯拉Model 3,還是帶基礎版輔助駕駛功能的。一直對標BBA(奔馳、寶馬、奧迪)的特斯拉在30萬以下的國內市場要展開一場“大屠殺”了,這對於整個國內電動車市場將會產生不小的沖擊。

不過,最讓筆者好奇的卻是,特斯拉自動駕駛是不是玩不動了,結合特斯拉多次升級後,自動駕駛事故依舊頻發,顯得其Autopilot自動駕駛系統一直雞肋,從未改變。

傳感器方案何時成熟?

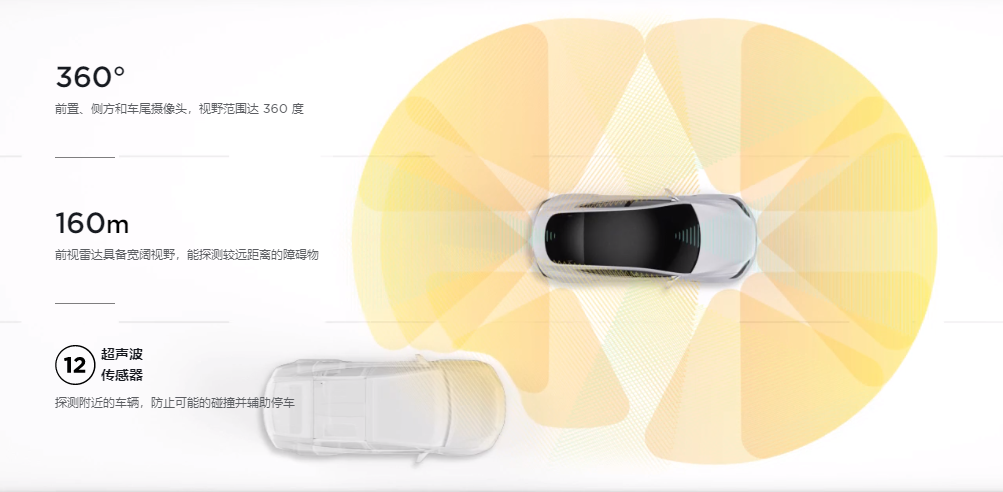

暫且不提Autopilot的軟件層面的問題,來說說它的Autopilot硬件系統。從Model 3整車來看,一共配置了8個攝像頭、12個超聲波傳感器、1個毫米波雷達,由於2019年4月,馬斯克diss了激光雷達的方案,所以特斯拉只能死磕毫米波雷達和其引以為豪的計算機視覺解決方案了。

先來看看特斯拉部分“鬼火”集錦,我們挑了一些具有相似性的進行比對。

2016年5月,處於自動輔助駕駛模式下的Model S撞上了前方正在低速左拐的大貨車

2018年1月,還是處於自動輔助駕駛系統的Model S撞上了路邊停放的消防車。

2019年8月,Model 3在自動輔助駕駛系統開啟的情況下莫斯科高速公路上撞上了路邊停放的拖車。

2019年12月,Model 3同樣在自動輔助駕駛系統開啟的情況下,撞上了靜止的警車。

其實,不難發現,特斯拉對於大型障礙物或者靜止的障礙物基本屬於“眼瞎”狀態。對於這種情況,理想汽車CEO李想曾表示,攝像頭配合毫米波雷達的組合就像青蛙的眼睛,動態判斷能力尚可,但是對於非標准的靜態物體幾乎無能,並且對於車輛以外的動態物體,識別率仍然不到80%。

要解開這個困惑,要從特斯拉Model 3攝像頭說起,8個攝像頭分別為3個位於車窗底部的前置攝像頭,左右B柱(車身支柱)各一個攝像頭和左右前輪翼子板下方的後視攝像頭各一個,以及一個用來倒車的車位攝像頭。這些攝像頭傳感器其實都是用來感知外部環境,這一塊主要是通過AI訓練讓攝像頭能夠識別物體,由於靜止物體種類多識別范圍太廣,有些事物沒有訓練過,例如,第一代Autopilot利用了Mobileye攝像頭,而這款攝像頭主要針對車頭和車尾進行訓練,車身側面訓練較少,遇到這種情況,系統無法識別,極有可能就漏報了。同時,對於快速移動的物體,攝像頭捕捉的圖像也是扭曲、模糊的,識別率也受影響。

另外,馬斯克diss激光雷達最大的資本就是他們的強大算法,但是,攝像頭的視覺總歸是二維的,8張圖片同時用算法處理,GPU的功耗負荷可見。而且,其使用的CMOS圖像傳感器在強光下的表現相當一般,會出現致盲的情況。

除了8個攝像頭,再來看看特斯拉用來測距的12個超聲波雷達。特斯拉使用的超聲波雷達的感測距離在30英尺左右,約9m。這裏拓展一下,超聲波雷達目前主要使用的是APA和UPA雷達,UPA雷達的最大量程為2-2.5m,APA最大量程至少是5m,也有超過7m的在使用中。特斯拉這個使用的APA超聲波雷達的9m感測范圍在業界屬於罕見品種,供應商的話,可以自行查閱。特斯拉使用的測距超聲波雷達主要是用於泊車庫位檢測,和高速橫向輔助,提升高速巡航功能的安全性和舒適性。但是,超聲波雷達缺點很明顯,溫度敏感,而且,超聲波傳感器本身最大的問題就是通信問題,例如, 12個超聲波雷達位於一個頻段,防止互相幹擾那就只能時分複用,12個攝像頭輪一圈,計算速度堪憂。

重點來了,馬斯克最喜愛的毫米波雷達,這也是自動駕駛傳感器爭議最多的部件。特斯拉Autopilot 1.0剛出來那會兒,主傳感器是上面提到的攝像頭,在出車禍啪啪打臉之後,特斯拉將毫米波雷達設為主傳感器。有人會問為啥要死磕毫米波雷達,還是那句話,便宜!便宜!便宜!重要的事情說三遍,毫米波雷達的成本價格普遍在千元左右,激光雷達萬元起步,作為商人的馬斯克還是需要考慮成本問題,畢竟產品太貴,沒人要,也不是個事兒。

話說回來,毫米波雷達優點是能夠高效穿透霧、煙、灰塵,具有較強的抗幹擾能力,但是在雨、霧和大雪等情況下效果一般。最致命的是,毫米波雷達幾乎無法區道路側面的金屬標牌或道路上停放的靜止汽車,因為雷達的空間分辨率很差,所以在算法上一般會忽略掉相對路面不移動的雷達回波,也就是會產生誤報的可能性。比如,一個金屬易拉罐底部凹陷的罐底位於汽車前方,反射回來的回波會被放大多倍,那就會造成車輛緊急制動。雖然特斯拉有表示通過點雲、雷達快照組裝、地圖數據庫進行處理,但是所謂的0.1s的快照組裝成的3D模型算法成熟速度、地圖數據庫的完整性如何去保證,何時能夠落地?

另外,2019年,特斯拉公布了自主研發的Autopilot 3.0芯片,替換了此前一直使用的英偉達 Drive PX 2 芯片,據稱運算能力是此前英偉達的10倍,真的是官方所表示的能夠具備“全自動駕駛能力”,馬斯克這回還會是嘴炮嗎,畢竟之前還是個L2級別的輔助駕駛。

車聯網是自動駕駛的未來

先不說筆者是激光雷達派系的還是毫米波視覺派系的,像特斯拉目前這種成熟度的自動輔助駕駛汽車,開啟自動模式上高速就是把腦袋別在腰上。要說到真正的自動駕駛,那還得把視角轉移到車聯網。聊到車聯網,總能讓筆者記起一句話。沒有V2X,駕駛也能自動,但是沒有V2X,無法真正的實現全場景自動駕駛。車聯網的核心技術就是V2X(Vehicle to Everything),即“車聯萬物”,嚴格來說,V2X是用來輔助提升機器駕駛車輛的技術。早在上世紀50年代,為了解決交通安全和堵車的問題,通用和美國無線電公司就聯合研究“元祖自動駕駛技術”了。

與自動駕駛所用的攝像頭和雷達等技術對比,V2X的傳感應用范圍更廣,探測距離更遠,理論值為300米,並且不受視覺、障礙物的影響,本質上可以把V2X視為一個拉長拉遠的“傳感器”。最關鍵的是,V2X能夠提供車輛之間行駛狀態的實時共享,通過和周邊車輛、道路、基礎設施的通訊,獲取比單車能得到的更多的信息,以及預測信息。另外,相比於目前自動駕駛在惡劣天氣下表現不佳的情況,V2X是唯一不受天氣影響的車用傳感技術。

舉例來講,特斯拉、百度所研發的無人駕駛汽車只是V2X的一個特定應用。譬如,特斯拉的Model 3無法識別障礙物類型的時候會出現車禍,但是借助V2X的信息共享機制,以及道路分析系統,Model 3完全可以避免車禍。此前,通用公司曾展示過自家的V2X技術,包括車輛盲區以及變道預警、交叉路口碰撞預警、緊急制動預警、前向碰撞預警、車速引導、前方急轉彎預警、道路濕滑預警等幾項安全應用。

目前,國內也有一些企業已經入局V2X,例如百度 Apollo 車路協同開源方案、阿裏雲智能高速公路解決方案、華為C-V2X 智慧車路協同解決方案,華為 LTE-V2X 基站,還有一些創企也在提供支持 LTE-V2X 的 OBU和 RSU 通信終端產品和高精度地圖系統。

在V2X產業鏈各環節成熟之前,現在的自動駕駛只能算輔助駕駛,因為它不成熟、不穩定、不安全,零事故率才是行業所追求的自動駕駛目標。所以,奉勸各位開特斯拉時,還是把雙手放在方向盤上。